Small Language Models in Enterprise-Unternehmen: Wofür sie sich eignen

Large Language Models (LLM) sind in aller Munde. Doch was ist mit den kleineren Verwandten, den Small Language Models (SLM)? Wir schauen uns an, was sie ausmacht, wofür sie geeignet sind, welche Modelle es gibt und wie man sie am besten zum Einsatz bringt.

Was sind Small Language Models (SLMs) und wofür eignen sich die kleinen Modelle?

Small Language Models, also kleine Sprachmodelle, sind kompakte Modelle für klar definierte Aufgaben. Sie sind kleiner als Large Language Models und laufen dadurch oft auf kleinerer Infrastruktur, mit geringerer Latenz und mehr Kontrolle über Datenflüsse.

SLMs sind darauf ausgelegt, wiederkehrende Sprachaufgaben zuverlässig zu lösen, mit konstanten Antwortzeiten und gut steuerbarem Infrastrukturbedarf. Im Unternehmenskontext zählt oft weniger die maximale Allgemeinfähigkeit, sondern reproduzierbare Qualität in Prozessen, die sich testen, überwachen und skalieren lässt.

1 bis 8 Mrd. Parameter in Enterprise-Unternehmen: Wann reicht ein kompaktes Modell aus?

SLM werden häufig basierend auf einer bis acht Milliarden Parametern (1 - 8B) trainiert. Damit sind sie deutlich kleiner als LLMs, die mit bis zu 400 Milliarden Parametern trainiert werden. Je weniger Parameter für das Training genutzt wurden, desto kleiner ist das Modell. Das hat Auswirkungen auf Faktoren wie Rechenbedarf und Leistungsfähigkeit. SLMs haben als den Vorteil, dass der Infrastrukturbedarf oft deutlich niedriger ist und sich Deployments schneller testen, versionieren und verlässlich betreiben lassen. Gleichzeitig sind Antwortzeiten in diesem Bereich unter Last besser planbar.

SLMs: Spezialisten für genau definierte Aufgaben

LLMs sind Generalisten, die bei offenen Aufgaben und hoher Varianz stark sind. SLMs sind eher Spezialisten, die bei gut definierten Tasks oft die bessere Kombination aus Kosten, Latenz und Kontrolle liefern. Typische SLM-Aufgaben sind Extraktion, Klassifikation, Routing, Zusammenfassung nach Vorlage oder standardisierte Assistenzfunktionen. LLMs ergänzen dort, wo Kontextbreite und Problemoffenheit nicht sauber in Teilaufgaben zerlegt werden können.

Typische Use Cases für SLM: Edge‑Deployment, Compliance‑Workflows und On‑Prem Dokumentenanalyse

SLMs sind sinnvoll, wenn Daten das eigene System nicht verlassen dürfen oder wenn Antwortzeiten verlässlich planbar bleiben müssen. Drei Use-Case-Klassen machen das greifbar: Edge-nahe Workflows, compliance-sensible Textverarbeitung und lokale Dokumentenpipelines.

Edge-Deployment geringe Latenz, Offline-Fähigkeit

SLMs laufen nahe an Maschinen, wenn Offlinefähigkeit oder geringe Latenz entscheidend sind. Das ist sinnvoll, wenn Workflows auch bei schwankender Verbindung funktionieren müssen. Typische Aufgaben sind Analyse von Wartungsnotizen, Klassifikation von Störmeldungen, Zusammenfassung von Schichtberichten oder Assistenz mit lokalem Dokumentenzugriff. Technisch wichtig sind quantisierte Runtimes, robuste Updates und Monitoring, das ohne unnötige Datenabflüsse auskommt. Für produktionsnahe Umgebungen zählt vor allem eine stabile P95 Latenz, nicht nur ein schneller Mittelwert.

Compliance-gerechte Textverarbeitung, Datenkontrolle & Auditierbarkeit

In regulierten Umgebungen übernehmen SLMs klar definierte Schritte wie Extraktion, Klassifikation und Zusammenfassung nach Standards. Das ist wichtig, wenn jede Verarbeitung nachvollziehbar dokumentiert werden muss. Relevante Bausteine sind Datenklassifizierung, Logging mit Redaction, reproduzierbare Inferenz und Versionierung von Modell und Prompts. Qualität wird über Regressionstests abgesichert, damit Änderungen nicht unbemerkt in produktive Prozesse durchrutschen. In der Praxis ist Formatdisziplin ein zentrales Qualitätskriterium, weil sie Prüfungen und Weiterverarbeitung erst zuverlässig macht.

Lokale Dokumentenanalyse, On-Prem & Datensouveränität

On-Prem-Betrieb ist hier oft regulatorisch oder organisatorisch vorgegeben. Das ist äußerst sinnvoll, wenn Dokumente das System nicht verlassen dürfen oder wenn zentrale Cloud Dienste nicht zulässig sind. SLMs unterstützen Dokumentenpipelines wie Aktenanalyse, Metadatenextraktion, interne Suche mit RAG und Zusammenfassungen für die Sachbearbeitung. Entscheidend sind Rollen und Zugriffskonzepte, nachvollziehbare Ergebnisse und ein Betrieb, der Updates, Rollback und Monitoring sauber abbildet. Für die Glaubwürdigkeit der Ergebnisse ist eine klare Quellenbindung wichtig, vor allem bei RAG, damit Aussagen auf auffindbare Textstellen zurückführbar bleiben.

Multi‑Agent Workflows: Darum sind SLM hier stark

Multi Agent Setups sind ein starkes Beispiel, wenn Aufgaben in klar definierte Schritte zerlegt werden können. SLMs eignen sich hier sehr gut, da mehrere spezialisierte Komponenten parallel laufen können, ohne die Kostenstruktur zu sprengen.

Rollenmodell: Extraktion, Klassifikation, Summarization, QA

Ein Extraktionsagent liefert strukturierte Felder in einem festen Schema. Ein Klassifikationsagent entscheidet über Routing oder Labels und liefert eine Confidence. Ein Summarization Agent erzeugt Texte nach Vorlage. Ein QA Agent prüft Format, Regeln und PII Redaction. Jede Rolle bekommt eigene Tests und Metriken, was Regression und Betrieb deutlich vereinfacht.

Orchestrierung: Routing, Guardrails, Evaluation

Routing steuert den Ablauf und definiert Eskalationspfade, zum Beispiel zu einem größeren Modell oder zu einem Human Review. Guardrails sichern Policies, erlaubte Tools und Outputformate ab. Evaluation läuft offline auf Golden Sets und online über Stichproben, Drift Signale und Fehlerklassen. So bleibt die Architektur messbar und steuerbar.

Warum SLMs hier besonders gut funktionieren

Mehrere spezialisierte Modelle lassen sich parallel betreiben. Das erhöht den Durchsatz und hält die Kosten pro Task konstant. Gleichzeitig bleibt jede Teilaufgabe isoliert testbar, was Tuning und Regression vereinfacht.

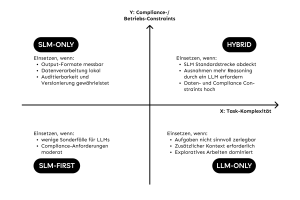

Teamwork Makes the Dream Work: Wann SLMs mit LLMs kombiniert werden sollten

Auch wenn es Use Cases gibt, für die ein SLM die beste Wahl ist, gibt es in der Praxis natürlich auch Fälle, bei denen die Entscheidung nicht so klar ist. Nicht immer ist die Entscheidung für nur ein Modelltyp möglich oder gar sinnvoll. Deshalb haben Unternehmen haben verschiedene Möglichkeiten, KI-Modelle einzusetzen. In der Praxis ergeben sich meist drei Zielbilder: SLM-only, SLM-first oder Hybrid. Ein SLM-first Ansatz mit Routing ist dabei oft der beste Weg, weil definierte Aufgaben lokal und kontrollierbar laufen und komplexe Fälle gezielt eskaliert werden können.

LLM-only bleibt der Ausnahmefall, wenn Aufgaben kaum zerlegbar sind und bewusst explorativ gelöst werden sollen. Der entscheidende Punkt ist nicht die Modellgröße, sondern ob ein Use Case klar testbar ist (Input/Output & Qualitätskriterien) und welche Betriebs- und Compliance-Constraints gelten. Routing hilft dabei, Standardfälle effizient zu verarbeiten und Ausnahmen gezielt zu eskalieren.

X-Achse, Task-Komplexität: Gemeint ist die Offenheit der Aufgabe. Niedrig heißt, Input und Output sind klar beschrieben und testbar. Hoch heißt, Inputs variieren stark, Kontext ist groß oder es braucht mehrstufiges Schlussfolgern ohne verlässliche Toolstruktur.

Y-Achse, Betrieb und Compliance Constraints: Gemeint sind Datenhoheit, Auditierbarkeit und Betriebsgrenzen. Hoch heißt, Edge-/Offline-Betrieb, strikte Vorgaben zu Datenflüssen, Logging/Redaction, Jurisdiktion, Auditierbarkeit. Niedrig heißt, weniger Einschränkungen, dafür oft mehr Flexibilität bei Skalierung und Managed Services.

In a nutshell: In vielen Enterprise-Szenarien ist eine hybride Architektur (SLM‑Default + LLM‑Fallback) ein praktikabler Weg, weil Standardfälle effizient laufen und Ausnahmen kontrolliert eskaliert werden können. Risiken wie Verzerrung und Halluzinationen bleiben grundsätzlich relevant und müssen durch Evaluation abgesichert

Top Small Language Models für Enterprise-Unternehmen: Modelle, Stärken und Einsatzprofile

Es gibt mittlerweile einige SLMs auf dem Markt. Wir haben sie unter die Lupe genommen und geschaut, wo ihr Stärken und Schwächen liegen.

Microsoft Phi, kompakt für strukturierte Enterprise Tasks

Phi eignet sich für Klassifikation, Extraktion und standardisierte Assistenz in klar definierten Workflows. Die Stärke liegt in effizienter Inferenz bei gleichbleibender Task-Qualität. Grenzen zeigen sich bei sehr offenen Aufgaben oder, wenn ohne Toolunterstützung komplexes Reasoning erwartet wird.

Praxisbeispiele: Dokumentenklassifikation und Routing, Strukturierte Datenextraktion (z. B. aus PDFs in JSON), Automatisierte Ticket-Kategorisierung im Support, Standardisierte Zusammenfassungen nach Vorlage.

Google Gemma, zuverlässig für Dokumenten-nahe Workloads

Gemma passt zu RAG gestützten Assistenzen und standardisierten Textprozessen. Entscheidend sind Output-Disziplin und Robustheit bei realen Dokumenten. Task-Tests mit produktionsnahen Daten sind hier aussagekräftiger als synthetische Benchmarks.

Praxisbeispiele: Dokumentenanalyse mit RAG (z. B. Verträge, Richtlinien), Interne Wissensassistenten für Fachabteilungen, Zusammenfassungen von Berichten und Protokollen, Extraktion von Informationen aus längeren Texten.

Meta Llama, robuste Basis für Plattformansätze

Llama eignet sich, wenn interne KI Plattformen mit Model Serving, Guardrails und Evaluationspipelines aufgebaut werden. Im 8B Segment bietet es einen ausgewogenen Kompromiss. Für Spezialdomänen wird das Modell häufig durch Retrieval-Augmented Generation (RAG) ergänzt, also den Zugriff auf unternehmensinterne Daten zur Laufzeit, oder gezielt feinjustiert.

Praxisbeispiele: Aufbau interner KI-Plattformen und APIs, Entwicklung von Assistenzsystemen für verschiedene Fachbereiche, Kombination mit RAG für unternehmensweite Wissenssuche, Grundlage für Multi-Agent-Systeme.

Mistral, kompakte Modelle für effiziente Deployments

Mistral bietet kompakte Varianten im Small-Segment, die auf effiziente Inferenz ausgelegt sind. Sie passen zu automatisierten Textprozessen und agentischen Teilaufgaben wie Routing oder Vorverarbeitung. In der Praxis zählen Lizenzrahmen, Lifecycle und Runtime-Kompatibilität stärker als einzelne Benchmarkwerte.

Praxisbeispiele: Vorverarbeitung und Normalisierung von Textdaten, Routing von Anfragen in Multi-Agent-Systemen, Automatisierte Textgenerierung mit klarer Struktur, Echtzeit-Assistenz in ressourcenbeschränkten Umgebungen.

Qwen, flexible Modellfamilie mit breitem Größenspektrum

Qwen ist interessant, wenn mehrere Modellgrößen für unterschiedliche Betriebsprofile benötigt werden. Das reicht von Standard-SLM bis zu kleineren Varianten für Edge oder Vorfilterung. In Enterprise-Kontexten sind Governance, Hostingoptionen und Evaluierbarkeit zentrale Auswahlkriterien.

Praxisbeispiele: Kombination mehrerer Modelle für unterschiedliche Tasks, Vorfilterung von Anfragen vor Weiterverarbeitung, Einsatz in Edge- und Cloud-Hybridarchitekturen, Anpassung an verschiedene Fachdomänen.

SmolLM, sehr kompakt für klar abgegrenzte Tasks

SmolLM aus dem Hugging-Face-Umfeld adressiert Szenarien mit engen Ressourcenbudgets. Geeignet für einfache Klassifikation, Vorfilterung oder strukturierte Extraktion. Bei hoher Kontextbreite oder stark variierenden Inputs ist ein größeres Modell sinnvoller.

Praxisbeispiele: Einfache Textklassifikation auf Edge-Geräten, Vorfilterung und Priorisierung von Anfragen, Pattern-basierte Extraktion aus kurzen Texten, Lightweight-Assistenz in Embedded-Systemen.

ChatGPT-mini, kompakte Varianten für Tool-nahe Workflows

Im ChatGPT Umfeld existieren ebenfalls kleinere Modellvarianten, die auf Effizienz ausgelegt sind. Sie eignen sich für standardisierte Assistenz, strukturierte Textaufgaben und API-nahe Workflows. Entscheidend ist hier die Integration in bestehende Plattform- und Governance-Strukturen.

Praxisbeispiele: Generierung strukturierter Texte (z. B. Reports, E-Mails), Unterstützung bei Softwareentwicklung (Code-Snippets, Dokumentation), Automatisierte Antworten in Chat- und Service-Systemen, Integration in bestehende Tools über APIs.

SLM-Auswahl in der Praxis: Darauf kommt es an

Bakeoff, Runtime und Betriebscheck: Die Auswahl eines geeigneten Modells kann überfordern. Deswegen ist es sinnvoll, ausgewählte Kriterien anzulegen, anhand derer eine bewusste Auswahl getroffen werden kann.

Step 1: Im ersten Schritt ist es wichtig auf Kriterien wie Input-Typ, Output-Format, Kontextlänge und Latenzbudget zu schauen. Dieser Schritt erlaubt eine gute Vorauswahl, da in der Regel eine Vielzahl an Modellen rausfallen, die für den gewünschten Use Case ungeeignet sind.

Step 2: Bei der übrig gebliebenen Auswahl an Modellen kann dann auf den Betrieb geschaut werden. Soll das Modell in der Cloud, on-Prem oder Edge betrieben werden? Wie hoch ist die verfügbare Runtime?

Entscheidung: Am Ende sollten zwei bis drei Modelle für die finale Auswahl übrig sein. Diese werden dann in einem sogenannten Bakeoff verglichen nach Kriterien wie Golden Set, P95-Latenz, Formatfehlerquote und Robustheit bei Stör-Inputs. Erst wenn Qualität und Betrieb zusammenpassen, wird skaliert.

SLMs in Betrieb nehmen

Ist die Entscheidung für ein oder mehrere Modelle gefallen, geht es darum, diese in Betrieb zu nehmen. SLM-Deployment ist weniger ein Modellthema als ein Servicethema. Entscheidend sind reproduzierbare Builds, eine zuverlässige Inferenz-Runtime und messbare Qualitäts-KPIs im Betrieb.

Serving und Runtime

Für die Inferenz braucht es eine Runtime, die Token-Durchsatz, Latenz und GPU-Scheduling beherrscht. Je nach Umgebung wird ein zentraler Inference-Service betrieben oder ein leichtgewichtiger On-Device-Stack genutzt. SLMs sind geeignet, wenn Ressourcen begrenzt sind oder Offline-Inferenz benötigt wird.

Containerisierung und Orchestrierung

Docker sorgt für reproduzierbare Deployments. Kubernetes übernimmt Rolling Updates, Autoscaling und das Einbinden von GPU-Nodes. In der Praxis lohnt es sich, Modellartefakte, Konfiguration und Prompt-Templates versioniert zu behandeln, damit Releases nachvollziehbar bleiben.

API-Integration und Security

Ein API-Gateway setzt Authentifizierung, Rate-Limits und Mandantenfähigkeit um. In regulierten Umgebungen ist zusätzlich wichtig, dass Logging und Telemetrie sensible Daten nicht unkontrolliert abgreifen.

Observability und Qualität

Neben klassischen Metriken wie P95-Latenz gehören Qualitätsmetriken dazu. Dazu zählen Formatfehlerquote, Abbruchrate, Halluzinationsindikatoren in RAG und Drift-Signale. Ohne kontinuierliche Validierung verliert selbst ein spezialisiertes Modell schnell an Verlässlichkeit.

On-Prem versus Edge

On-Prem priorisiert Auditierbarkeit, Freigabeprozesse, Patchmanagement und Datenflusskontrolle. Edge priorisiert Offlinefähigkeit, Ressourcenlimits und verteilte Updates. NTT DATA beschreibt den Nutzen lokaler Laufzeiten in Werken und OT-Umgebungen und verbindet das direkt mit Antwortzeiten ohne Cloud-Umweg.

Fazit: SLM-first als sinnvolle Enterprise Strategie

SLM-first ist ein belastbares Zielbild für klar definierte Enterprise Tasks. Small Language Models übernehmen die Standardstrecke, Large Language Models ergänzen dort, wo Kontextbreite oder offene Problemstellungen es erfordern. Entscheidend ist ein Betriebsmodell, das wie Softwareengineering geführt wird, mit klarer Taskdefinition, Evaluation und Monitoring.

Ein Assessment priorisiert Use Cases nach Nutzen, Datenklasse und Machbarkeit. Ein Workshop verankert Entscheidungsmatrix, Zielarchitektur und Betriebsmodell. Ein Pilot liefert belastbare KPIs, Taskqualität, P95 Latenz, Kosten pro Anfrage und Compliance Fit, als Grundlage für Skalierung in Plattform und Multi Agent Muster.