-

Viele Unternehmen nutzen KI, haben aber keinen vollständigen Überblick über ihre Systeme und Risiken

-

Der EU AI Act macht strukturierte KI-Governance verpflichtend, besonders ab August 2026

-

Ein klarer Rahmen aus Inventar, Risikoeinordnung und Verantwortlichkeiten ist jetzt entscheidend

EU AI Act 2026: Was Unternehmen tun müssen, bevor die Regulierung zuschlägt

Viele Unternehmen skalieren KI – aber kaum eines kann heute eindeutig sagen, welche KI-Systeme tatsächlich im Einsatz sind. Fachbereiche nutzen GenAI-Tools, Modelle unterstützen Entscheidungen, erste Agentensysteme orchestrieren Prozesse. Gleichzeitig rücken regulatorische Anforderungen durch den EU AI Act näher, die weltweit erste umfassende Verordnung der EU zur Kontrolle Künstlicher Intelligenz.

Während politisch bereits über dessen Anpassung diskutiert wird – etwa im Rahmen des Regulierungspakets Digital Omnibus, das die Komplexität europäischer Digitalgesetze reduzieren soll – bleibt eine Tatsache unverändert: Unternehmen müssen ihre KI-Systeme transparent, kontrollierbar und nachvollziehbar betreiben.

Spätestens mit Blick auf August 2026, wenn zentrale Betreiberpflichten greifen, stellt sich eine zentrale Frage: Ist deine KI-Landschaft so aufgebaut, dass sie regulatorisch wasserdicht, technisch sauber betreibbar und skalierbar ist?

TL;DR

EU AI Act einfach erklärt: Warum Regulierung deine Architektur verändert

Der EU AI Act ist der weltweit erste umfassende Rechtsrahmen für Künstliche Intelligenz und soll Europa helfen, international eine führende Rolle einzunehmen. Sein Ziel ist es, vertrauenswürdige KI in Europa zu fördern. Er folgt einem risikobasierten Ansatz: Je nach Einsatzbereich gelten für Entwickler:innen und Hersteller:innen von KI unterschiedliche Anforderungen. Entscheidend sind der Einsatzkontext und welche Auswirkungen ein System auf Menschen oder kritische Prozesse haben kann.

Aber nicht nur Entwickler:innen und Hersteller:innen sind vom EU AI Act betroffen, sondern auch Unternehmen, die KI-Systeme nutzen, verkaufen oder betreiben. Für viele Organisationen bedeutet das also, dass Anwendungen in Bereichen wie HR-Entscheidungen, Kreditvergabe, öffentlicher Verwaltung und kritischer Infrastruktur schnell als Hochrisiko-KI eingeordnet werden können. Damit verschiebt sich der Fokus: Der AI Act ist kein reines Compliance-Thema, sondern betrifft direkt Architektur, Governance und Betriebsmodelle von KI.

Risikoklassen im EU AI Act: Wie KI-Systeme eingeordnet werden

Der EU AI Act unterscheidet vier Risikostufen, die bestimmen, welche Anforderungen gelten:

Minimales Risiko

KI-Systeme mit geringem Einfluss auf Rechte oder Sicherheit, etwa Chatbots oder Empfehlungssysteme. Hier gelten kaum regulatorische Anforderungen.

Begrenztes Risiko

Systeme mit moderatem Einfluss, darunter viele General Purpose AI (GPAI)-Modelle. Es gelten vor allem Transparenzpflichten, etwa die Kennzeichnung von KI-generierten Inhalten.

Hohes Risiko

Anwendungen, die erheblichen Einfluss auf Menschen oder kritische Prozesse haben, z. B. in HR, Kreditvergabe oder kritischer Infrastruktur. Für sie gelten strenge Anforderungen entlang des gesamten Lebenszyklus.

Unvertretbares Risiko

KI-Systeme, die Grundrechte oder Sicherheit gefährden, sind verboten. Diese Regelung gilt bereits seit Februar 2025.

Ab August 2026 werden für solche Systeme umfangreiche Betreiberpflichten verbindlich. Dann reicht es nicht mehr, einzelne Richtlinien oder Policies zu haben. Es braucht nachvollziehbare Strukturen über den gesamten Lebenszyklus eines KI-Systems hinweg.

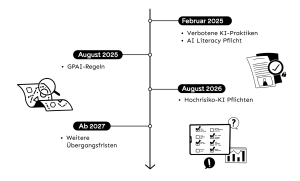

Timeline: Alle vergangenen und kommenden Regelungen im Überblick

Seit dem 2. Februar 2025 sind verbotene KI-Praktiken untersagt. Gleichzeitig müssen Unternehmen sicherstellen, dass ausreichend AI Literacy vorhanden ist. Mitarbeitende sollen über die nötigen Kompetenzen verfügen, um KI verantwortungsvoll einsetzen zu können.

Seit dem 2. August 2025 gelten zudem neue Regeln für General Purpose AI (GPAI). Dazu zählen Anforderungen an technische Dokumentation, Transparenz, Robustheit sowie die Einhaltung von Copyright-Vorgaben. Für Unternehmen als Anwender bedeutet das vor allem, dass sie klar verstehen müssen, wo die Verantwortung des Modellanbieters endet und wo ihre eigene beginnt. Das betrifft beispielsweise die Zweckbindung eines Modells, das Monitoring im konkreten Use Case sowie Logging und Nachvollziehbarkeit.

Ab dem 2. August 2026 greifen umfassende Betreiberpflichten für Hochrisiko-KI. Dazu gehören unter anderem Risikomanagementsysteme, Daten-Governance, Dokumentation, Human Oversight sowie Monitoring und Logging. Diese Anforderungen betreffen nicht nur Legal- oder Compliance-Funktionen, sondern wirken direkt auf das Systemdesign.

Ab 2027 gelten darüber hinaus weitere Übergangsfristen, unter anderem für bestimmte Konstellationen von bereits am Markt befindlichen GPAI-Modellen.

Weitere Übergangsfristen gelten unter anderem für bestimmte Konstellationen von bereits am Markt befindlichen GPAI-Modellen.

Digital Omnibus: Was sich für Unternehmen jetzt ändern könnte

von Johannes Martiny, Senior Manager Digital Transformation

Parallel zum Inkrafttreten des AI Act diskutiert die EU bereits über Anpassungen der Digitalregulierung. Mit dem sogenannten Digital Omnibus möchte die EU-Kommission zentrale Digitalvorschriften wie DSGVO, AI Act und Data Act vereinfachen und bürokratische Hürden abbauen.

Diskutiert werden unter anderem:

vereinfachte Dokumentationspflichten für kleinere Unternehmen

zentralisierte Aufsicht beim EU AI Office

mögliche Erleichterungen beim Umgang mit personenbezogenen Daten im KI-Training

Zusätzlich gibt es erste politische Signale, dass Fristen für bestimmte Anforderungen angepasst werden könnten. So wird aktuell diskutiert, die Anwendung von Regeln für Hochrisiko-KI teilweise zu verschieben, um Unternehmen mehr Zeit für Umsetzung und Standardisierung zu geben.

Noch ist unklar, welche Änderungen tatsächlich umgesetzt werden. Für Unternehmen bedeutet das vor allem eines: Regulatorische Details können sich verändern, der Bedarf an strukturierter KI-Governance bleibt jedoch bestehen. Gleichzeitig könnten vereinfachte Vorgaben und klarere Zeitpläne die praktische Umsetzung erleichtern.

von Johannes Martiny, Senior Manager Digital Transformation

KI im Unternehmen: Typische Herausforderungen bei Governance und Überblick

In den letzten zwei Jahren ist viel passiert: Generative KI hat mit Anwendungen wie ChatGPT und Copilot den Sprung in den Alltag geschafft, ein Großteil der Unternehmen setzen KI zunehmend produktiv ein. Und mit dem EU-AI Act wurde erstmals ein umfassender regulatorischer Rahmen geschaffen.

Gleichzeitig zeigt sich in Gesprächen ein wiederkehrendes Muster: Viele Unternehmen treiben bereits zahlreiche KI-Initiativen voran, haben jedoch keinen klaren Gesamtüberblick. Governance wird zwar als wichtig erachtet, aber unterschiedlich interpretiert, und obwohl klar ist, dass 2026 an Relevanz gewinnt, fehlt oft ein konkreter Einstiegspunkt.

Der AI Act zwingt Unternehmen nicht, weniger KI zu nutzen. Er zwingt sie, bewusster damit umzugehen. Und genau diese Bewusstheit fehlt häufig noch.

Drei Signale zeigen, dass Handlungsbedarf besteht:

Kein vollständiges KI-Inventar: Eigenentwicklungen, SaaS-Tools mit KI-Funktionen, KI-Features in Standardsoftware und automatisierte Entscheidungsunterstützungen werden nicht zentral erfasst. Ohne diesen Überblick bleibt jede weitere Diskussion vage.

Unklare Risikoeinordnung: Ob ein System als Hochrisiko gilt, ist nicht systematisch bewertet. Wer das nicht weiß, weiß auch nicht, welche Anforderungen gelten.

Fehlende Ownership: Es ist unklar, wer für welches KI-System Verantwortung trägt – zwischen IT, Fachbereich, Data und Compliance.

EU AI Act Einstieg: Die drei zentralen Fragen für Unternehmen

Bevor es um Detailanforderungen geht, stehen drei grundlegende Fragen im Raum, die als Orientierung für den Einstieg in die EU AI Act Umsetzung dienen:

Welche KI-Systeme nutzen wir überhaupt?

Dazu zählen nicht nur Eigenentwicklungen, sondern auch SaaS-Tools mit KI-Funktionen, KI-Features in Standardsoftware sowie Automatisierungen, die Entscheidungen vorbereiten.Wie sind diese Use Cases regulatorisch einzuordnen?

Die Risikoklassifizierung entscheidet darüber, welche Anforderungen gelten, welche Dokumentation notwendig ist und wo Prioritäten gesetzt werden müssen.Ist unsere Organisation darauf vorbereitet?

Dabei geht es um Rollen und Verantwortlichkeiten, klare Entscheidungswege, technische Leitplanken sowie tragfähige Governance-Strukturen.

Diese Punkte hängen eng zusammen. Ohne Transparenz keine Einordnung. Ohne Einordnung keine gezielte Umsetzung.

EU AI Act Roadmap: In drei Schritten zum Operating Model

Um aus dieser Situation herauszukommen, braucht es im Kontext des EU AI Act kein Mammutprojekt. Entscheidend ist die richtige Reihenfolge:

Schritt 1: Strukturierte Analyse

Use Cases werden identifiziert, grob klassifiziert und in Beziehung zu bestehenden Rollen, Prozessen und Gremien gesetzt. Häufig zeigt sich hier, dass bereits viele Bausteine existieren, aber nicht miteinander verzahnt sind.

Schritt 2: Governance konkret übersetzen

Nicht abstrakt definiert, sondern konkret auf das eigene Target Operating Model übertragen: Wer entscheidet was? Wer trägt Verantwortung? Wo greifen Kontrollmechanismen? Wie werden regulatorische Anforderungen systematisch berücksichtigt?

Schritt 3: Technische Maßnahmen priorisieren

Logging, Monitoring, Dokumentation oder Human-in-the-Loop-Mechanismen werden nicht mehr als isolierte Aufgaben behandelt, sondern als Bestandteile eines durchdachten Gesamtsystems.

Parallel: Befähigung ausbauen

AI Literacy bedeutet, dass Mitarbeitende verstehen, welche Rolle KI in ihrem Arbeitskontext spielt, welche Grenzen gelten und wie sie Systeme verantwortungsvoll einsetzen. Ohne dieses gemeinsame Verständnis bleibt Governance Theorie.

Praxisbeispiel aus einem Mobiliätsunternehmen: Vom KI-Experiment zur AI Act fähigen Struktur

Bei einem nationalen Mobilitätsunternehmen standen bereits zahlreiche KI-Anwendungen im Einsatz – von ersten GenAI Use Cases bis hin zu automatisierten Entscheidungsunterstützungen.

Die Herausforderung: Die Initiativen waren lokal entstanden, unterschiedlich dokumentiert und organisatorisch nicht klar verankert. Ein vollständiger Überblick über eingesetzte Systeme, Risiken und Verantwortlichkeiten fehlte.

Gemeinsam wurde ein strukturierter Ansatz entwickelt, um die bestehende KI-Landschaft in ein belastbares Operating Model zu überführen.

Im Fokus standen dabei drei zentrale Schritte:

Transparenz schaffen

Aufbau eines zentralen KI-Inventars über alle Bereiche hinweg, inklusive Einordnung bestehender Use Cases.

Governance definieren

Klare Rollen, Verantwortlichkeiten und Entscheidungsprozesse entlang des gesamten KI-Lebenszyklus.

Strukturen etablieren

Einführung von Leitplanken für Entwicklung und Betrieb, ergänzt durch modulare Services, die neue Use Cases standardisiert integrierbar machen.

Das Ergebnis: Statt isolierter KI-Initiativen entstand ein konsistenter Rahmen, der sowohl regulatorische Anforderungen berücksichtigt als auch die Einführung neuer Anwendungen beschleunigt.

AI Act Ready: Checkliste für Unternehmen

Vollständige Perfektion ist kein realistisches Ziel. Entscheidend ist, ob die Grundlagen stehen. Mit diesen Elementen entsteht Orientierung. Neue Use Cases lassen sich schneller bewerten. Bestehende Anwendungen werden transparenter. Diskussionen werden sachlicher.

-

Ein transparentes, bereichsübergreifendes KI-Inventar ist vorhanden

-

Für jeden Use Case liegt eine dokumentierte Risikoeinordnung vor

-

Rollen und Verantwortlichkeiten entlang des KI-Lebenszyklus sind klar definiert

-

Technische und organisatorische Leitplanken sorgen für Nachvollziehbarkeit und Kontrolle

-

Ein strukturiertes Konzept für AI Literacy ist etabliert

Jetzt ist der Moment für Klarheit

Ab dem 2. August 2026 gilt der EU AI Act zu großen Teilen, mit Bußgeldern bis 35 Mio. Euro (7 % Jahresumsatz). Für viele Unternehmen bleiben nur noch wenige Planungszyklen, um aus verteilten Initiativen ein tragfähiges System zu machen. Der EU AI Act liefert dafür den äußeren Rahmen. Die eigentliche Arbeit liegt jedoch intern. Jetzt ist es wichtig Transparenz zu schaffen, Risiken einzuordnen, Verantwortlichkeiten zu klären und technische Leitplanken zu setzen.

Bleibe auf dem Laufenden: Folge uns auf LinkedIn und abonniere unseren Newsletter

Spotlight

Get in Touch

Johannes Martiny

Senior Manager Digital Transformation

+49 172 9880104